AI 訓練的新瓶頸不是 GPU,而是資料供應

在 AI 模型規模急速膨脹的當下,企業往往將焦點鎖定在 GPU 的運算能力,隨著 GPU 運算能力不斷地向上提升,全新的挑戰也開始一一浮現。一旦資料無法即時送達,儲存系統無法即時「餵飽」GPU,昂貴的 GPU 算力資源便只能閒置空轉。根據研究顯示,在大型 AI 訓練中,I/O 等待時間可能就佔據了 30% 以上的總訓練時間,直接拖慢模型收斂速度不說,更成為降低投資報酬率的隱形殺手。

然而,傳統的儲存效能驗證多半著重於 IOPS、吞吐量等單點指標,難以反映真實 AI 訓練的資料行為。企業往往在部署後才猛然發現效能瓶頸,進而引發專案延誤、架構重工,甚至影響產品上市時程等連鎖反應。當儲存系統無法跟上資料需求時,縱使 GPU 再強大,卻也只能被迫閒置,造成訓練時間拉長、成本上升、效能不穩定等諸多風險。

MLPerf Storage:AI儲存效能測試新標竿

百佳泰結合Golden Methodology,協助企業在不同AI訓練場景下進行效能評估

為了有效克服這個難題,由 MLCommons 所制定的國際標準測試「MLPerf Storage」便應運而生,專門評估 AI 訓練過程中的儲存系統效能,企業方可透過統一規範進行不同儲存方案的效能比較,確保硬體投資得以發揮最大效益。

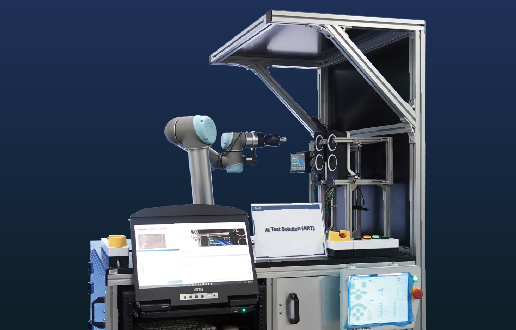

百佳泰解決方案

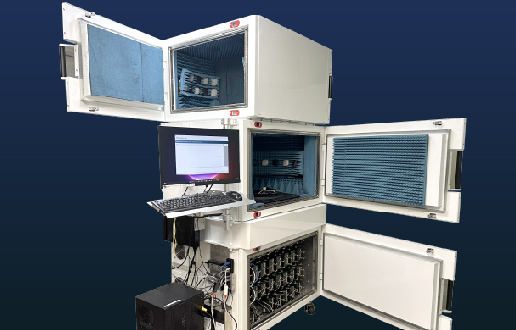

為協助企業客戶以更快、更有效率的方式進行效能評估,百佳泰除了建置完整的 MLPerf Storage 檢測環境,更結合自有的 Golden Methodology,提供客戶 MLPerf Storage 驗證及評估服務,包括:

- AI 效能驗證:針對各類 Storage 設備進行效能檢測與驗證

- 效能比較分析:橫跨不同 Storage 設備進行 AI 效能優劣比較,提供決策依據

為何您需要 MLPerf Storage

MLCommons 是全球領先的 AI 基準組織,目前已超過 125 家科技公司、學術單位與MLCommons研究機構進行合作。其基準測試涵蓋 AI 效能、資料集、風險與可靠性評估,並在近年來成為業界公認的新標準。

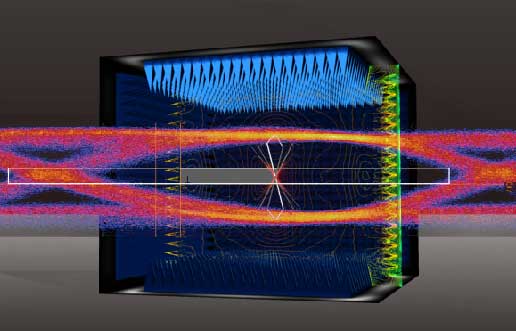

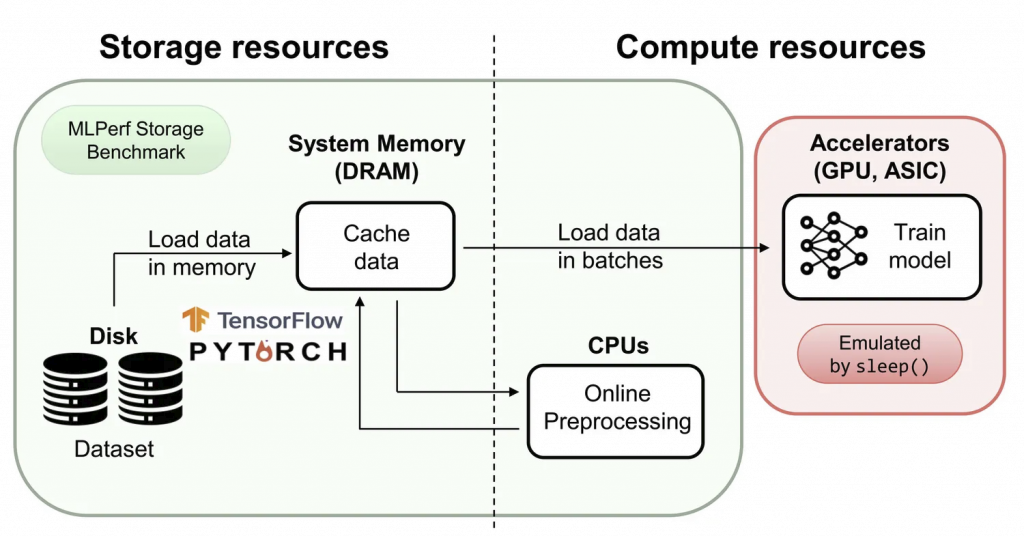

MLPerf Storage 與 MLPerf Training、MLPerf Inference 同屬於 MLCommons 基準測試家族,MLPerf Storage 專注於模擬真實 AI 訓練的資料存取模式,而非單純的 IOPS 或吞吐量檢測。並採用虛擬加速器(Virtual Accelerators)來模擬 GPU 的資料請求模式,取代實體 GPU,藉此將評估焦點鎖定在儲存系統本身的效能表現,以避免受到 GPU 計算能力差異的干擾,精確揭示 I/O 與資料傳輸環節的潛在瓶頸。

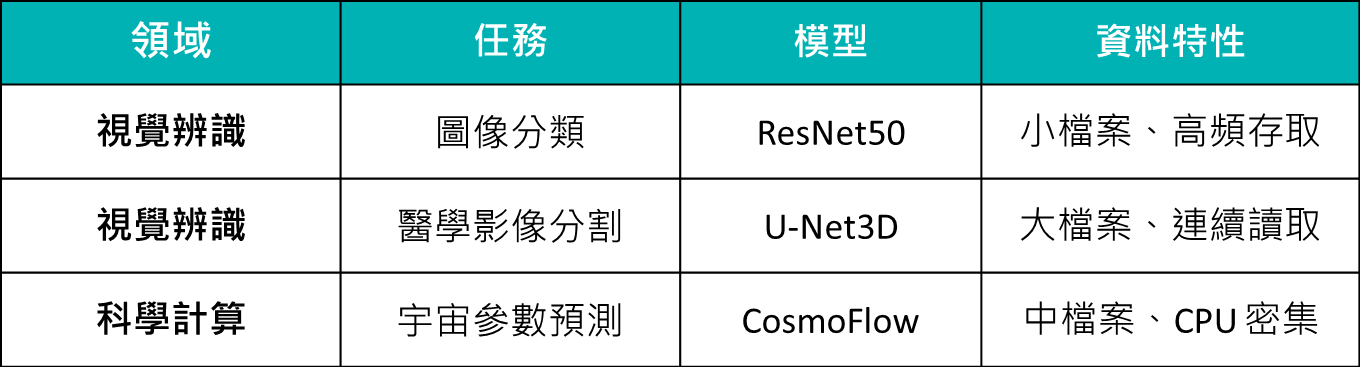

主要工作負載

測試指標

- Training Throughput (samples/sec):每秒可處理的訓練樣本數,直接影響模型收斂速度。

- Training I/O Throughput (MB/sec):資料傳輸速率,反映儲存系統能否「餵飽」GPU。

- Accelerator Utilization (AU%):GPU 忙碌比例,越高代表投資效益越佳。

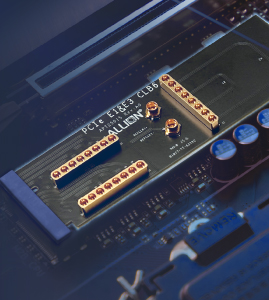

百佳泰實測案例:SSD產品在不同AI訓練場景下的效能差異分析

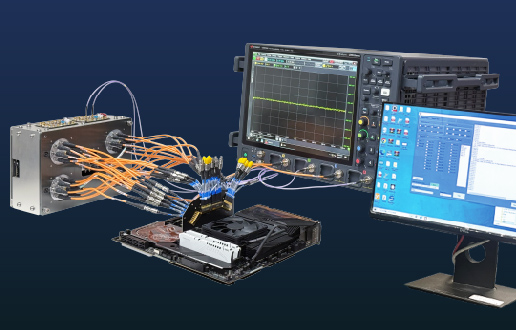

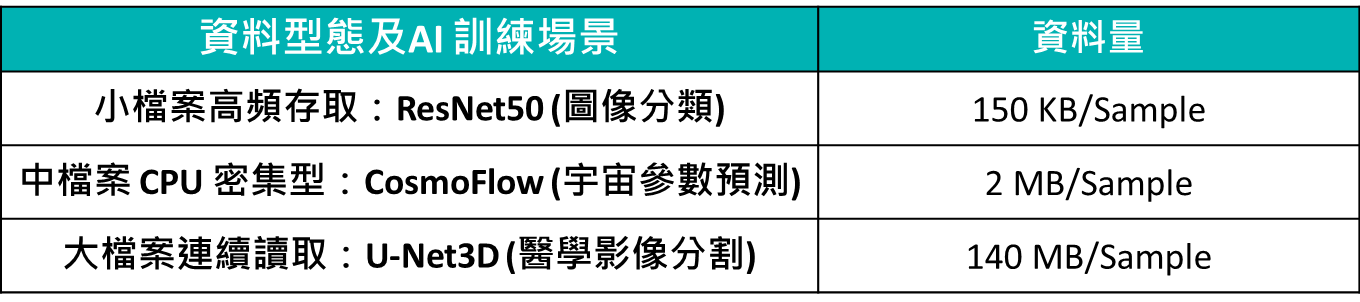

在百佳泰提供的 MLPerf Storage 驗證環境中,我們針對企業級 SSD 進行了多項工作負載評估,並涵蓋 ResNet50、3D U-Net與 CosmoFlow 等 AI 訓練場景,藉此真實反映不同資料型態(小圖像、中型科學資料、大型醫學影像)對儲存系統的需求。本次實測主要透過模擬 NVIDIA A100 / H100 GPU 的資料存取行為,因此不需要實際 GPU,即可重現真實 AI 訓練的 I/O 模式。

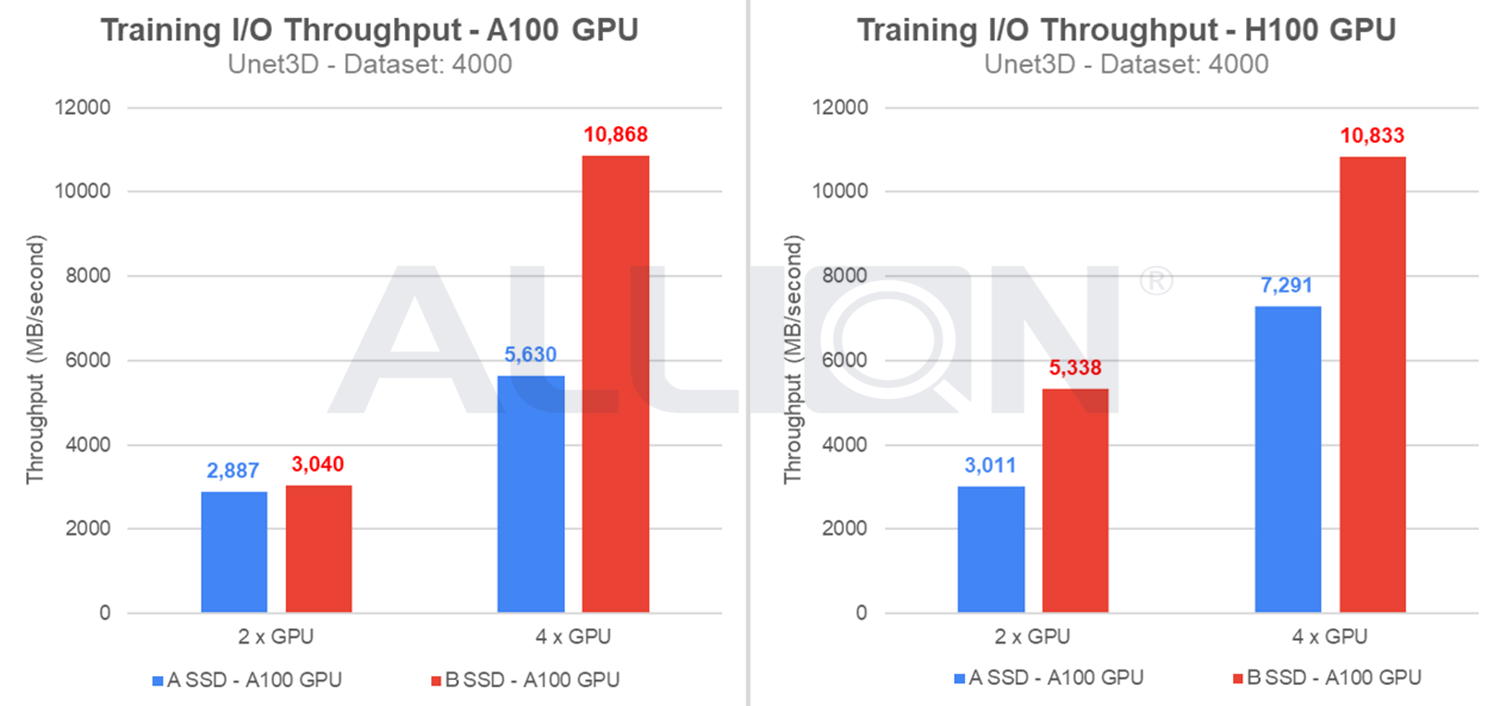

下圖是使用 U-Net3D 這個模型,運行4,000個 Dataset sample 下的 Storage Training I/O Throughput (MB/sec) 比較結果。從圖中我們可以看到,B 型號 SSD 的 I/O Throughput 表現明顯優於 A 型號,不僅能更快速地供應訓練資料,進而縮短整體訓練時間。足於證明了儲存效能對 AI 訓練效率的直接影響。

Faster, Easier, Better!百佳泰MLPerf Storage驗證評估服務

百佳泰引入 MLCommons 制定的 MLPerf Storage 國際標準,透過虛擬加速器(Virtual Accelerators)精準模擬 GPU 的資料請求模式,完整重現 AI 訓練過程中的 I/O 行為。讓企業在產品開發初期即可掌握儲存系統在真實訓練負載下的表現,而非依賴傳統檢測的理想化數據。

百佳泰不僅打造 MLPerf Storage 標準化檢測環境,更結合深厚的豐富經驗及專案實績,從「產品開發除錯」到「市場競爭分析」,我們以更快速、更便捷,同時更加完善的方式,提供客戶專業到位的一站式顧問諮詢服務。

Faster:加速產品上市,縮短模型訓練週期

精準定位瓶頸,加速開發驗證

百佳泰採用虛擬加速器(Virtual Accelerators)技術取代實體 GPU,進而排除運算力差異的干擾,精確揭示儲存系統在 I/O 與資料傳輸環節的潛在瓶頸。協助開發團隊能更快速地針對儲存控製器或韌體進行優化,大幅縮短產品除錯與調校週期。

實證效能提升,展現速度優勢

百佳泰的實測數據證明,優化後的 SSD 在 U-Net3D(醫學影像分割)模型下,I/O Throughput 表現顯著優於競品,更能快速供應訓練資料。透過我們的驗證,客戶產品將可進一步縮短 AI 訓練時間,加速完成模型收斂。

Easier:一站式顧問服務,模擬真實場景零門檻

覆蓋多元 AI 工作負載,使用情境真實模擬

百佳泰的檢測環境涵蓋三大關鍵領域,真實反映不同資料型態的需求。客戶無需自行建置昂貴的 AI 訓練叢集或撰寫複雜腳本,即可獲取貼近真實應用場景的效能數據。

- 圖像分類 (ResNet50):針對小檔案、高頻隨機存取效能。

- 醫學影像 (U-Net3D):針對大檔案、連續讀取吞吐量。

- 科學計算 (CosmoFlow):針對中型檔案、CPU 密集型運算。

Better:客觀決策依據,投資效益極大化

跨設備效能比較,提供採購決策支援

若企業客戶需要在多種儲存方案中進行採購決策,我們可提供您跨廠牌、跨型號的效能比較分析服務。百佳泰依據 Training Throughput (samples/sec) 與 Accelerator Utilization (AU%) 等關鍵指標,協助客戶客觀評估硬體性價比,確保每一分一毫的硬體投資都能發揮最大效益。

專業技術團隊,潛在風險深入剖析

不僅止於跑分,百佳泰顧問團隊更可根據實測結果進行深度分析。一旦發現產品存在潛在風險(如在高負載下的掉速或延遲),我們將協助客戶釐清問題根源,並提供客製化的修正建議與解決方案,確保產品在 AI 時代具備最強的品質競爭力。

若您對於 MLPerf Storage 有任何問題或進一步需求,歡迎透過線上表單與我們聯繫,百佳泰服務團隊將誠摯為您服務!

有煩惱,就來問!百佳泰專家幫你解答

不論產品、產業、生態圈,填表就能問專家!

更多成功案例